发布时间:2026年4月10日 北京时间

2025年以来,直播电商市场规模已突破4.9万亿元-5。当你的直播间还在依赖真人主播轮班时,AI无人直播系统已经可以实现7×24小时不间断运营。本文将从零开始,带你完整理解AI无人直播助手的核心原理,并提供可直接运行的代码示例与高频面试考点。

一、痛点切入:为什么传统直播需要AI无人直播助手?

来看一段传统直播的伪代码实现:

传统直播流程 class HumanLiveStream: def __init__(self, host): self.host = host 依赖真人主播 self.schedule = "8小时" 时间受限 self.cost = 20000 月成本2万+ def run(self): while self.host.is_awake(): self.host.speak() self.host.check_comments() self.host.answer_questions()

痛点分析:

人力成本高:一个成熟主播月薪1-3万,加上助播和运营团队,每月人力成本5-10万-3

时间有限:真人主播每天最多播8-10小时,凌晨和清晨的流量完全浪费-3

状态不稳定:生病、请假、情绪波动都会影响直播效果

培养周期长:培养一个合格主播需要3-6个月

正是这些痛点,催生了AI无人直播助手的出现。

二、核心概念:什么是AI无人直播助手?

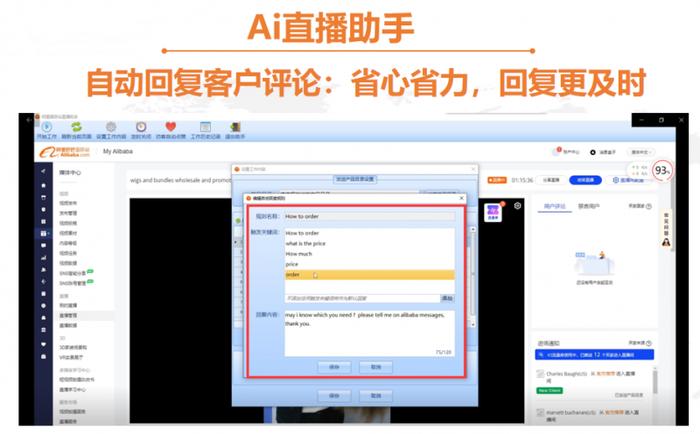

AI无人直播助手(Artificial Intelligence Unmanned Live Streaming Assistant),是一套利用人工智能技术替代真人完成直播全流程的系统。它整合了计算机视觉(Computer Vision, CV)、自然语言处理(Natural Language Processing, NLP)、语音合成(Text-to-Speech, TTS)和大语言模型(Large Language Model, LLM)等技术,实现直播内容的自动化生成、智能互动与7×24小时不间断运营-41。

生活化类比:想象一个永不下班的“超级售货员”——它能自动讲解商品、秒回顾客问题、根据销量调整推销话术。真人售货员需要吃饭睡觉,但它永远在线,这就是AI无人直播助手的角色。

三、关联概念:AI数字人与AI直播助手的区别

AI数字人(AI Digital Human):基于3D建模或2D渲染生成的虚拟形象,具备真实的外貌、表情和动作,通过多模态技术实现“形神音容”的统一-1。

AI直播助手(AI Live Streaming Assistant):更广义的概念,既包括数字人形态,也包括“去形象化”的纯音频主播形态-7。

核心区别:

AI数字人:强调形象存在感,适用于需要视觉交互的场景(如品牌直播、虚拟偶像)

AI直播助手:强调功能实用性,部分方案只输出声音,算力成本更低(低至5算力/小时,约0.5元/小时)-7

一句话总结:AI数字人是“能看到的人”,AI直播助手是“能做事的大脑”——前者侧重形象,后者侧重功能,二者常常协同工作。

四、技术架构:AI无人直播助手的“三角支撑体系”

AI无人直播系统并非单一技术的产物,而是计算机视觉、自然语言处理、实时数据交互三大技术模块协同作用的结果,三者如同三角支架,共同支撑起自动化直播的全流程-44。

┌─────────────────────────────────────────────────────────┐ │ AI无人直播系统 │ ├───────────────┬───────────────┬─────────────────────────┤ │ 视觉中枢 │ 交互大脑 │ 神经脉络 │ │ (计算机视觉) │ (NLP/LLM) │ (实时数据交互) │ ├───────────────┼───────────────┼─────────────────────────┤ │ 商品识别 │ 弹幕语义解析 │ 商品库存实时同步 │ │ 动作捕捉 │ 智能问答生成 │ 用户画像动态匹配 │ │ 场景渲染 │ 话术自动生成 │ 订单数据联动触发 │ └───────────────┴───────────────┴─────────────────────────┘

以下是AI无人直播助手ASR → LLM → TTS → 视觉驱动的标准交互流程-29:

AI无人直播助手的核心交互流程 def ai_live_assistant_pipeline(user_input: str): """ 输入: 用户弹幕或语音提问 输出: 虚拟主播的语音+画面回复 """ 1. ASR - 语音识别(用户语音输入场景) from whisper import load_model asr_model = load_model("base") user_text = asr_model.transcribe(user_audio)["text"] 2. LLM - 大模型语义理解与话术生成 from openai import OpenAI client = OpenAI() response = client.chat.completions.create( model="gpt-4", messages=[ {"role": "system", "content": "你是电商直播助手,回答要自然带货"}, {"role": "user", "content": user_text} ] ) assistant_reply = response.choices[0].message.content 3. TTS - 文本转语音 import edge_tts audio_output = edge_tts.communicate(assistant_reply) 4. 唇形同步与视频合成 调用LiveTalking或Wav2Lip等模型,将音频驱动为唇形动画 video_output = lip_sync(audio_output, avatar_model) return video_output 推流至直播平台

五、实战代码示例:基于LiveTalking搭建AI无人直播系统

LiveTalking是一个开源的实时多模态数字人驱动系统,具备ASR语音识别、LLM大模型对话、TTS语音合成和唇形同步等核心能力,是学习AI无人直播助手的最佳入门项目-29。

完整系统代码:

LiveTalking 核心系统 - AI无人直播助手全流程 import asyncio from typing import Optional ============ 模块1: ASR语音识别模块 ============ class ASRModule: """自动语音识别 - 将用户语音转为文本""" def __init__(self, model_type="whisper"): if model_type == "whisper": import whisper self.model = whisper.load_model("base") else: from vosk import Model self.model = Model("model-en") 轻量级离线模型 def transcribe(self, audio_path: str) -> str: result = self.model.transcribe(audio_path) return result["text"] ============ 模块2: LLM大语言模型模块 ============ class LLMModule: """大语言模型 - 理解用户意图并生成回复""" def __init__(self, api_key: str, model="gpt-3.5-turbo"): from openai import OpenAI self.client = OpenAI(api_key=api_key) self.model = model self.context = [] 对话上下文记忆 async def chat(self, user_input: str) -> str: self.context.append({"role": "user", "content": user_input}) response = self.client.chat.completions.create( model=self.model, messages=self.context, temperature=0.7, max_tokens=150 ) reply = response.choices[0].message.content self.context.append({"role": "assistant", "content": reply}) return reply ============ 模块3: TTS语音合成模块 ============ class TTSModule: """文本转语音 - 将回复文本转为自然语音""" def __init__(self, voice="zh-CN-XiaoxiaoNeural"): import edge_tts self.voice = voice async def synthesize(self, text: str, output_path: str) -> str: communicate = edge_tts.Communicate(text, self.voice) await communicate.save(output_path) return output_path ============ 模块4: 唇形同步模块 ============ class LipSyncModule: """音频驱动唇形动画 - 实现口型同步""" def __init__(self, model_path: str = "wav2lip"): 使用Wav2Lip模型进行音频到唇形的映射 实际部署时需加载预训练权重 pass def generate_video(self, audio_path: str, avatar_image: str) -> str: """ 将音频与静态头像合成口型同步视频 返回视频文件路径 """ 此处为示意逻辑,实际调用Wav2Lip推理 output_path = "output_lipsync.mp4" ... 模型推理逻辑 ... return output_path ============ 主控程序: AI无人直播助手 ============ class AIUnmannedLiveAssistant: """AI无人直播助手主控系统""" def __init__(self, api_key: str, avatar_path: str): self.asr = ASRModule() self.llm = LLMModule(api_key) self.tts = TTSModule() self.lipsync = LipSyncModule() self.avatar = avatar_path async def process_user_audio(self, audio_input: str) -> str: """处理用户语音输入,返回视频输出路径""" Step 1: ASR 语音识别 user_text = self.asr.transcribe(audio_input) print(f"👤 用户说: {user_text}") Step 2: LLM 智能生成回复 assistant_text = await self.llm.chat(user_text) print(f"🤖 AI回复: {assistant_text}") Step 3: TTS 语音合成 audio_output = await self.tts.synthesize(assistant_text, "temp_audio.mp3") Step 4: 唇形同步合成视频 video_output = self.lipsync.generate_video(audio_output, self.avatar) return video_output async def run_continuously(self): """24小时不间断运行""" print("🎬 AI无人直播助手已启动,正在推流...") while True: 监听直播间弹幕和语音输入 实际应用中需集成OBS推流和RTMP协议 await asyncio.sleep(1) 启动示例 async def main(): assistant = AIUnmannedLiveAssistant( api_key="your-openai-api-key", avatar_path="avatar_image.png" ) 处理单次请求 result = await assistant.process_user_audio("user_audio.wav") print(f"✅ 生成视频: {result}") if __name__ == "__main__": asyncio.run(main())

关键步骤解释:

ASR(自动语音识别):使用Whisper或Vosk将用户的语音提问转为文本

LLM(大语言模型):调用GPT或Qwen等模型理解语义并生成带货回复

TTS(文本转语音):将回复文本合成为自然语音,支持多语言

唇形同步:使用Wav2Lip或MuseTalk将音频映射为虚拟主播的嘴型动画-29

推流输出:通过RTMP协议将合成的视频推送到直播平台

六、底层原理:支撑AI无人直播助手的关键技术栈

AI无人直播助手的底层依赖以下核心技术:

1. 多模态大语言模型(Multimodal LLM):融合文本、图像、音频的跨模态理解能力。如百度NOVA依托文心大模型4.5 Turbo,仅需10分钟真人样本即可完成声音、动作与情绪的精准复刻-22。

2. 音频驱动数字人技术(Audio-Driven Avatar) :通过HRTF头部相关传递函数算法实时解析音频中的空间方位信息,驱动数字人头部转向、眼神聚焦等动作,误差控制在±3°以内-13。

3. 低延迟实时传输协议(RTC/WHEP) :摒弃传统的FLV/HLS协议(延迟3-5秒),全面采用RTC实时通信技术架构,配合WHEP协议实现全链路<1秒的超低延迟互动-15。

4. 云原生弹性算力架构(Cloud-Native Elastic Computing) :通过云端GPU算力的集中调度和弹性扩容,系统可同时支撑数百个高清数字人直播间稳定运行,算力资源利用率提升40%以上-2。

七、行业落地现状

百度NOVA:曾支撑罗永浩数字人直播间创下5500万元GMV,累计超10万主播受益-22

腾讯HunyuanVideo-Avatar:开源音频驱动数字人技术,将夜间时段GMV占比从12%提升至28%,GPU占用率从85%降至42%-13

海尔AI直播中心:在武汉建成家电行业国内首个AI直播中心,设置AI数字人直播间实现24小时无人直播-33

八、高频面试题与参考答案

Q1:请简述AI无人直播助手的核心技术架构。

参考答案:AI无人直播助手采用“感知-决策-表达”三层架构。感知层集成ASR语音识别和计算机视觉,采集用户输入和直播画面;决策层通过LLM大语言模型进行语义理解、意图识别和话术生成;表达层利用TTS语音合成和唇形同步技术,驱动虚拟主播输出音视频内容。三层协同工作,实现从输入到输出的全流程自动化。

Q2:如何解决AI无人直播的实时交互延迟问题?

参考答案:主要从三个维度解决。一是协议优化,摒弃延迟3-5秒的传统FLV/HLS协议,采用RTC实时通信和WHEP协议,实现<1秒全链路延迟-15。二是边缘计算,将渲染任务下沉至边缘节点,降低终端设备压力。三是模型轻量化,通过NeRF神经辐射场与网格变形混合渲染,将GPU占用率从85%降至42%-13。

Q3:AI数字人与传统录播直播的本质区别是什么?

参考答案:核心区别在于实时交互能力。传统录播直播是单向内容播放,无法响应观众提问。AI数字人通过ASR+LLM+TTS的多模态处理链路,能够实时理解用户输入并生成个性化的语音回复,同时驱动形象做出匹配的表情和动作,实现了“真交互”而非“假播放”。

Q4:如何评估AI无人直播助手的拟真程度?

参考答案:常用MOS评分(Mean Opinion Score)体系,满分5分。当前头部方案语音自然度可达MOS 4.2分以上-4。评估维度包括:语音自然度(音色、语调、停顿)、唇形同步精度、表情动作匹配度、问答准确率(头部方案可达92%以上-44),以及用户是否能分辨回复来自真人还是AI。

九、结尾总结

本文围绕AI无人直播助手的核心原理、技术架构和实战应用,完整梳理了从传统直播痛点到智能化解决方案的全链路知识:

| 知识点 | 核心要点 |

|---|---|

| 痛点分析 | 人力成本高、时间有限、状态不稳 |

| 核心概念 | AI无人直播助手 = CV + NLP + TTS + LLM |

| 技术架构 | 感知层→决策层→表达层,ASR→LLM→TTS→视觉驱动 |

| 实战代码 | LiveTalking开源系统完整示例 |

| 底层原理 | 多模态LLM + 音频驱动 + RTC低延迟 + 云原生算力 |

| 面试考点 | 架构设计、延迟优化、数字人vs录播、MOS评估 |

进阶预告:下一篇将深入讲解AI无人直播助手的多模态模型微调实践,包括如何用自家产品数据训练专属话术模型、如何在边缘设备上实现实时推理,敬请期待!